Dify实操

Dify实操

蔡坨坨转载请注明出处❤️

作者:测试蔡坨坨

原文链接:caituotuo.top/c9a55b66.html

Dify简介

Docker环境准备

Dify部署

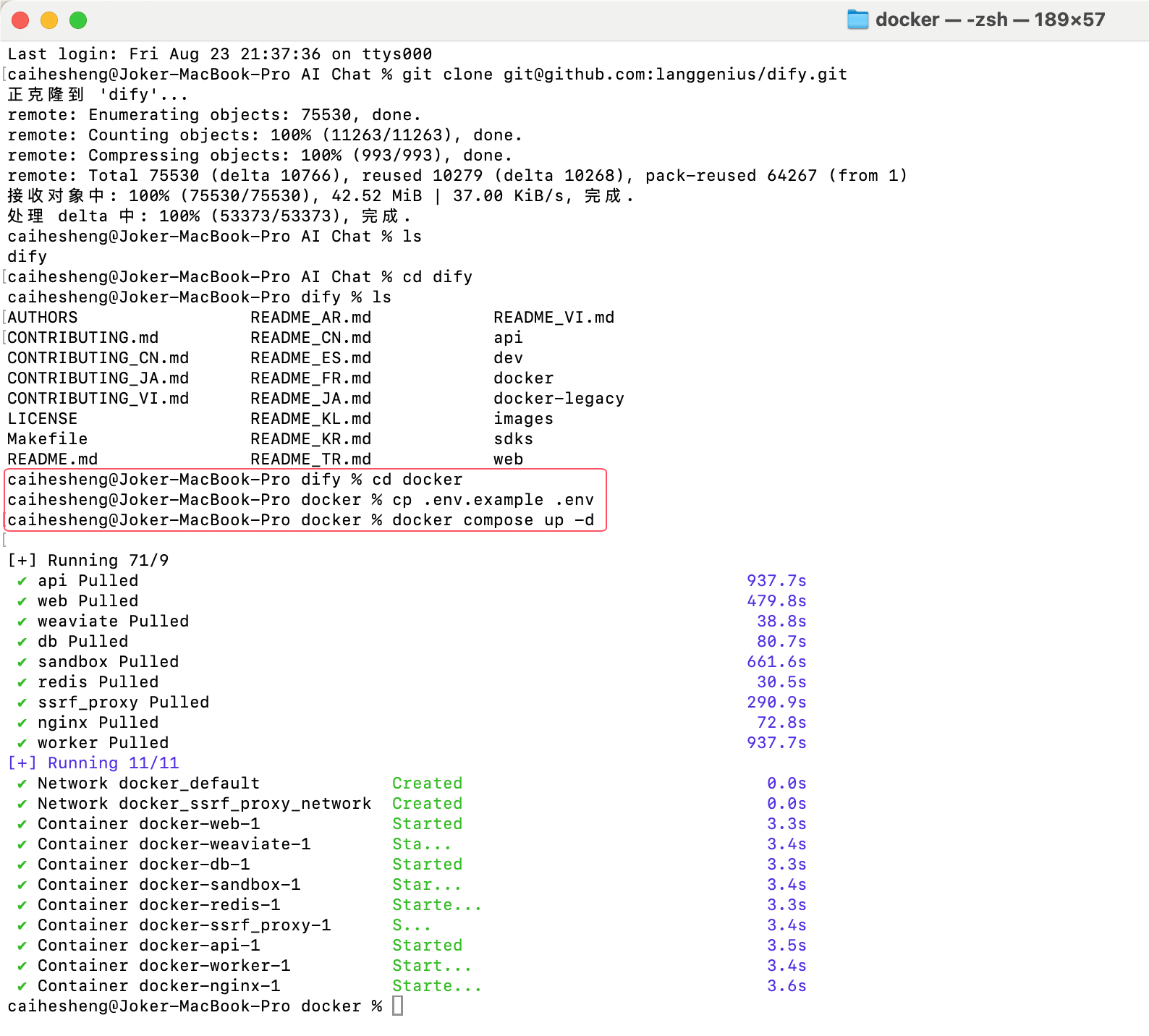

clone源码到本地

1 | git clone git@github.com:langgenius/dify.git |

docker命令部署

进入docker文件夹:

1 | cd docker |

首次部署需复制环境配置:

1 | cp .env.example .env |

启动项目:

1 | docker compose up -d |

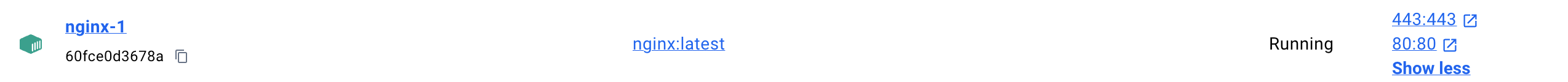

访问项目

Nginx默认运行在80端口:

浏览器访问:http://localhost

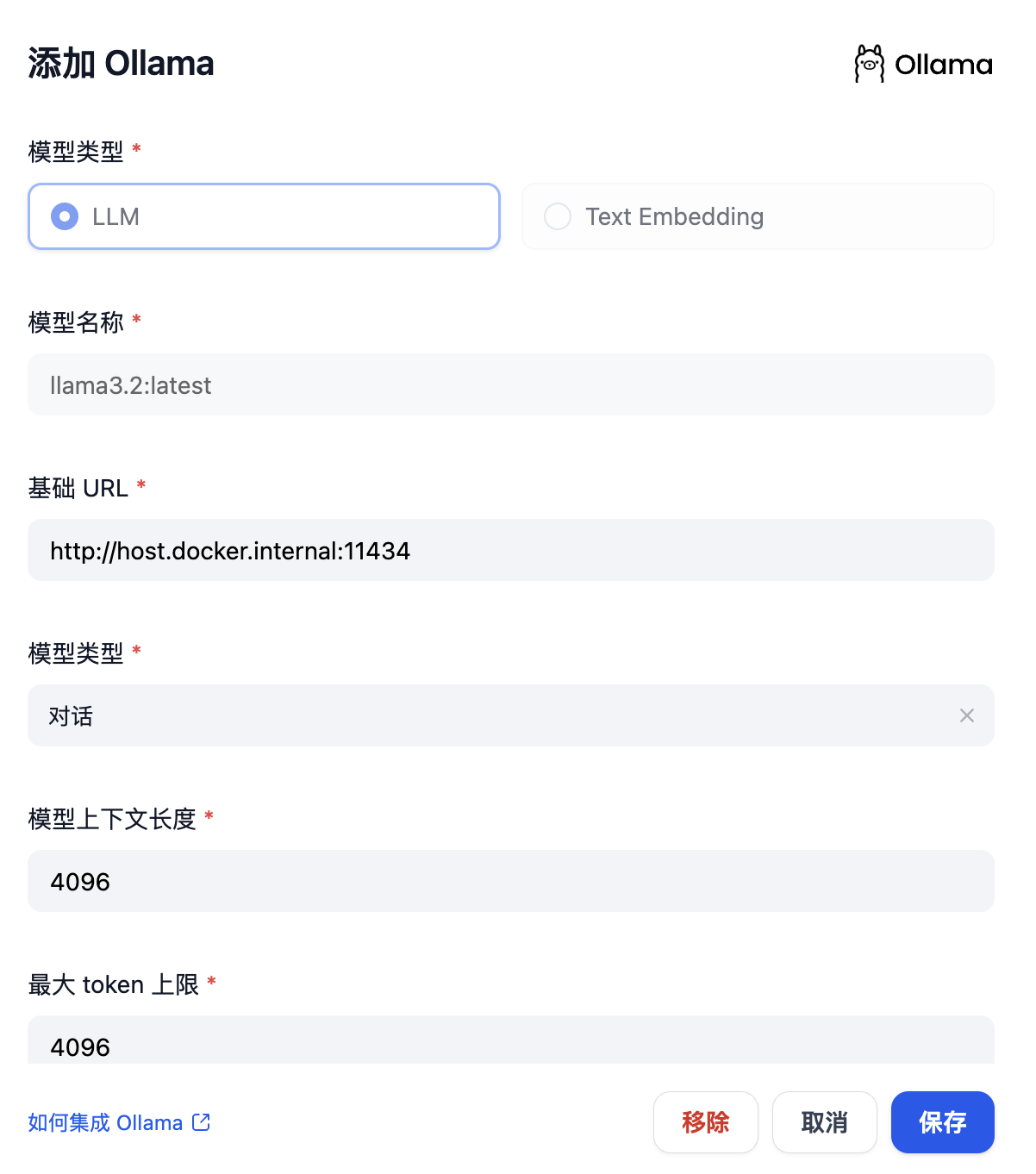

配置Ollama模型

模型名称:ollama list 查看

URL:http://host.docker.internal:11434

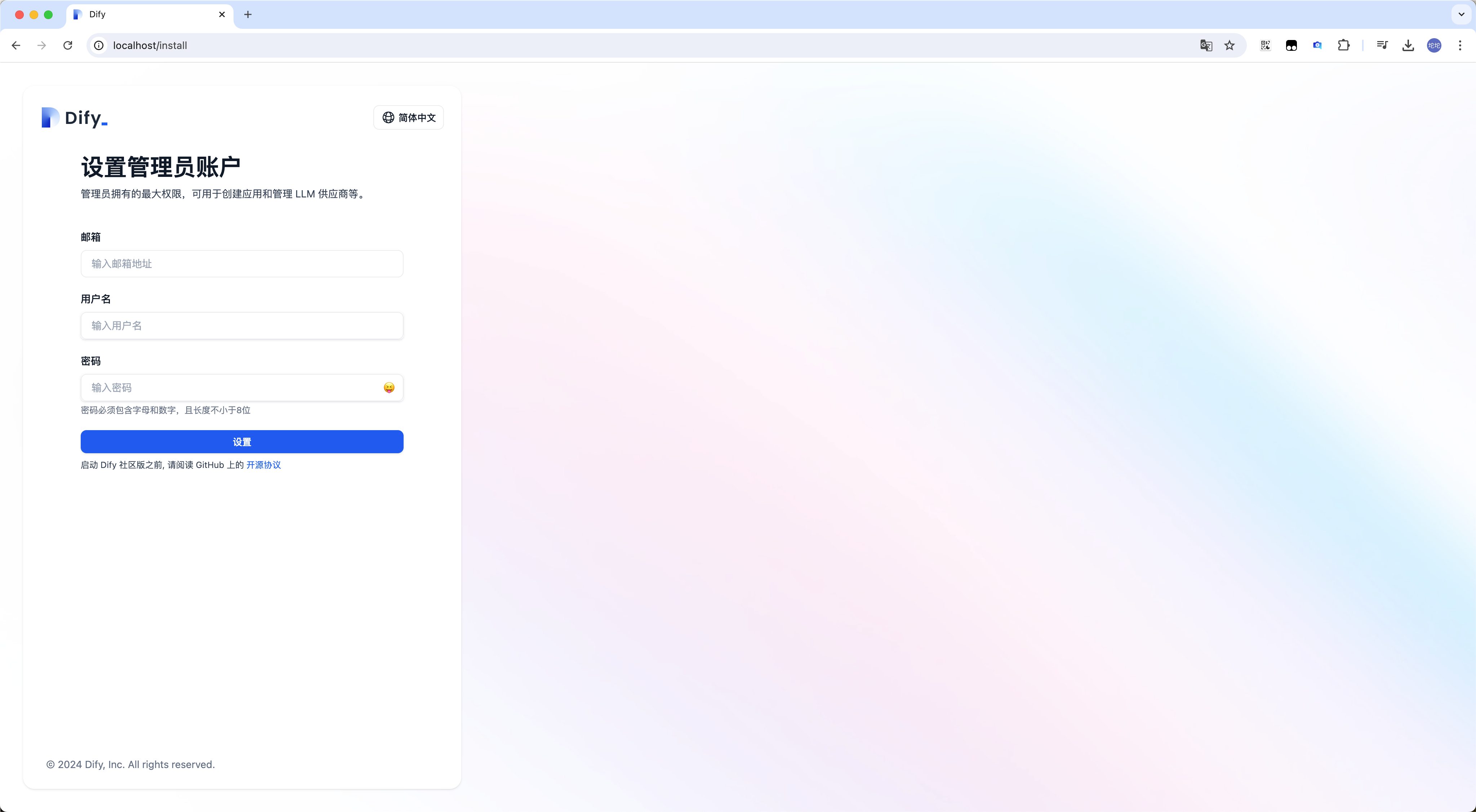

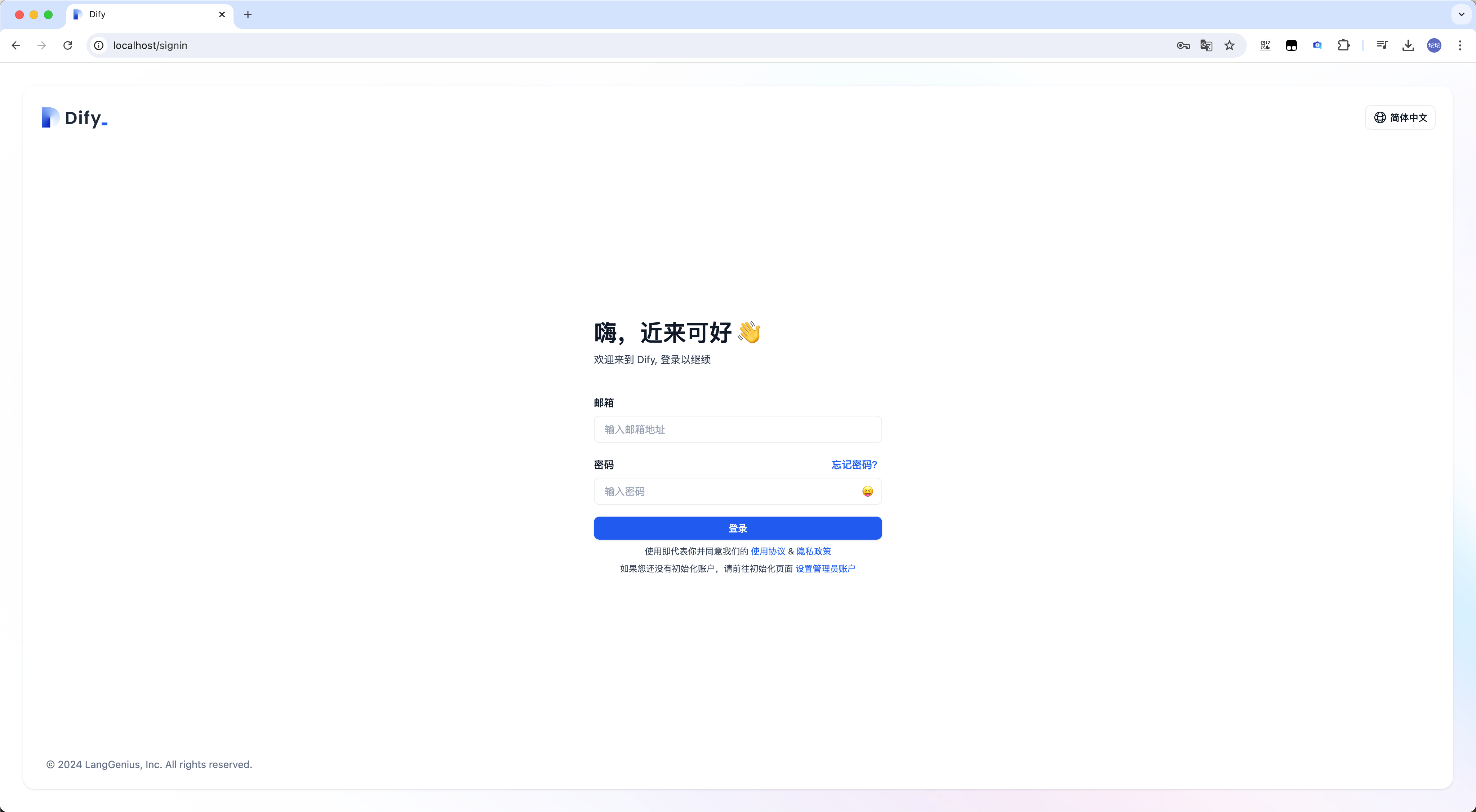

首次部署需设置管理员账号:邮箱+密码

添加管理员账号后,默认跳转到登录页面:

Dify源码解析

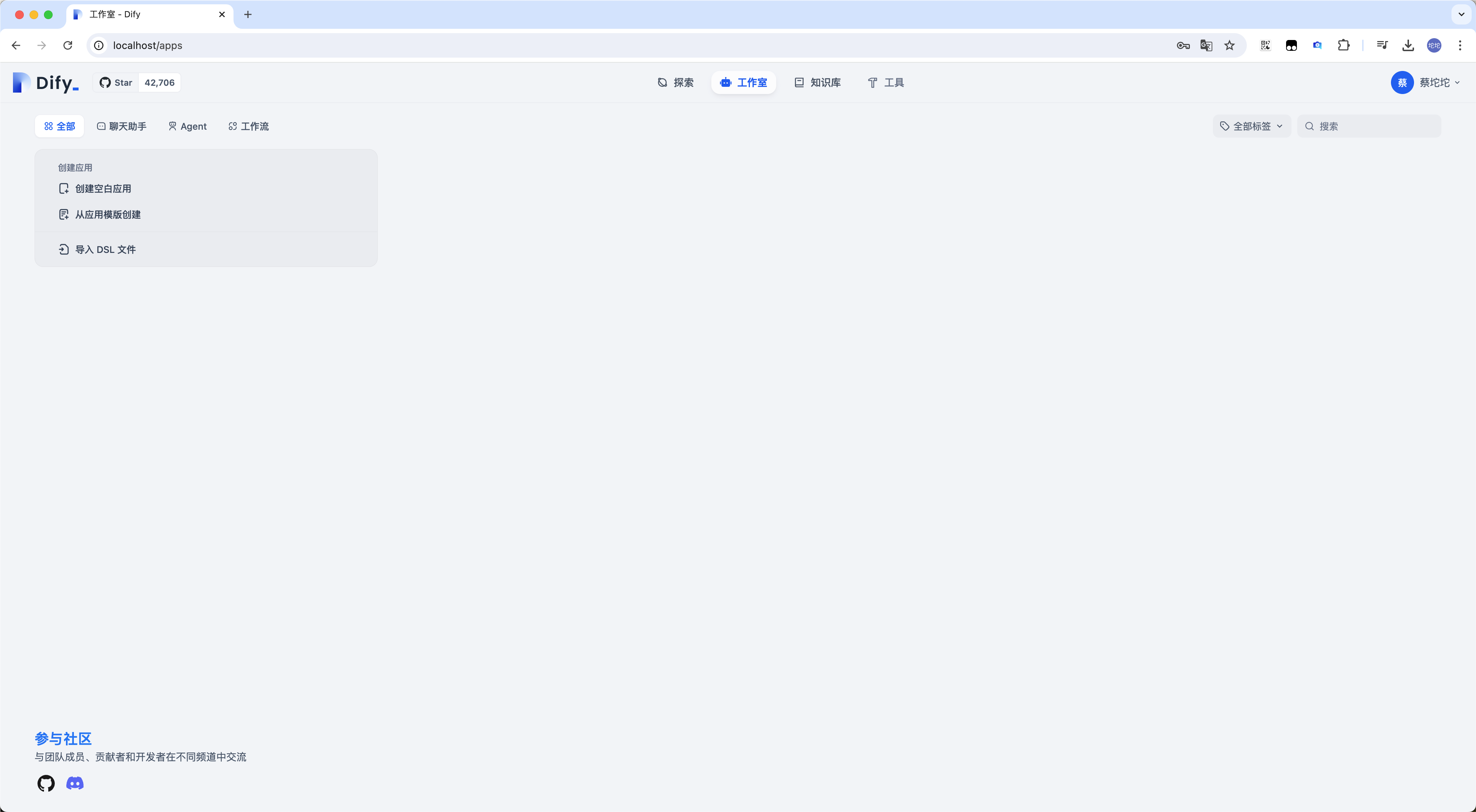

简单Dify聊天机器人

典型的基于知识库的大语言模型应用,也是RAG的典型应用。

基于所提供的上下文回答问题,如果上下文信息与提问无关,请回答“很抱歉,我不知道”。

知识库的维护

手动上传文档

Markdown文件、PDF文件

通过API维护

基于聊天工作流的RAG应用构建

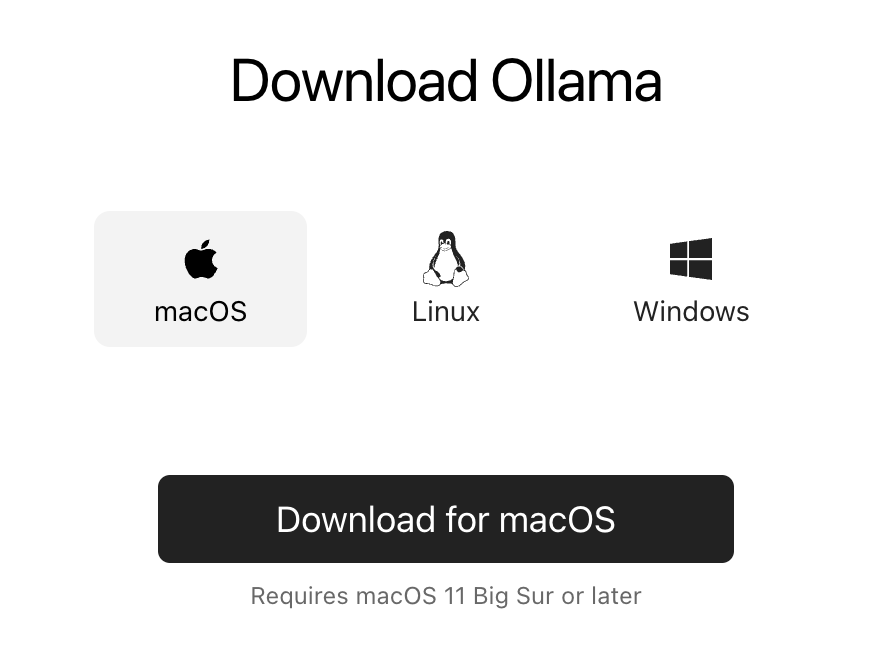

Ollama

安装

官网:https://ollama.com/download

下载对应系统的安装包并安装:

常用命令

查看已安装的模型:

1 | ollama list |

模型

文字:

代码:

社区版只支持单租户

只能购买商业版,开源协议上说明了社区版不支持多租户,无法修改源码。

cat controllers/console/error.py

ToDo

集成微信生态圈:企业微信、公众号、小程序等

有反馈机制:点赞和点踩

实现用户反馈机制,用于衡量文档的质量(好与坏),并对内容进行优化。

dify本身就有日志和标记功能,也有对应的API,但是没有直观的界面可以看出哪些AI回答的标记是多少,可以通过接口抓包获取数据后加工分析。

通过爬虫的方式获取数据源、读取数据库、读取代码等方式

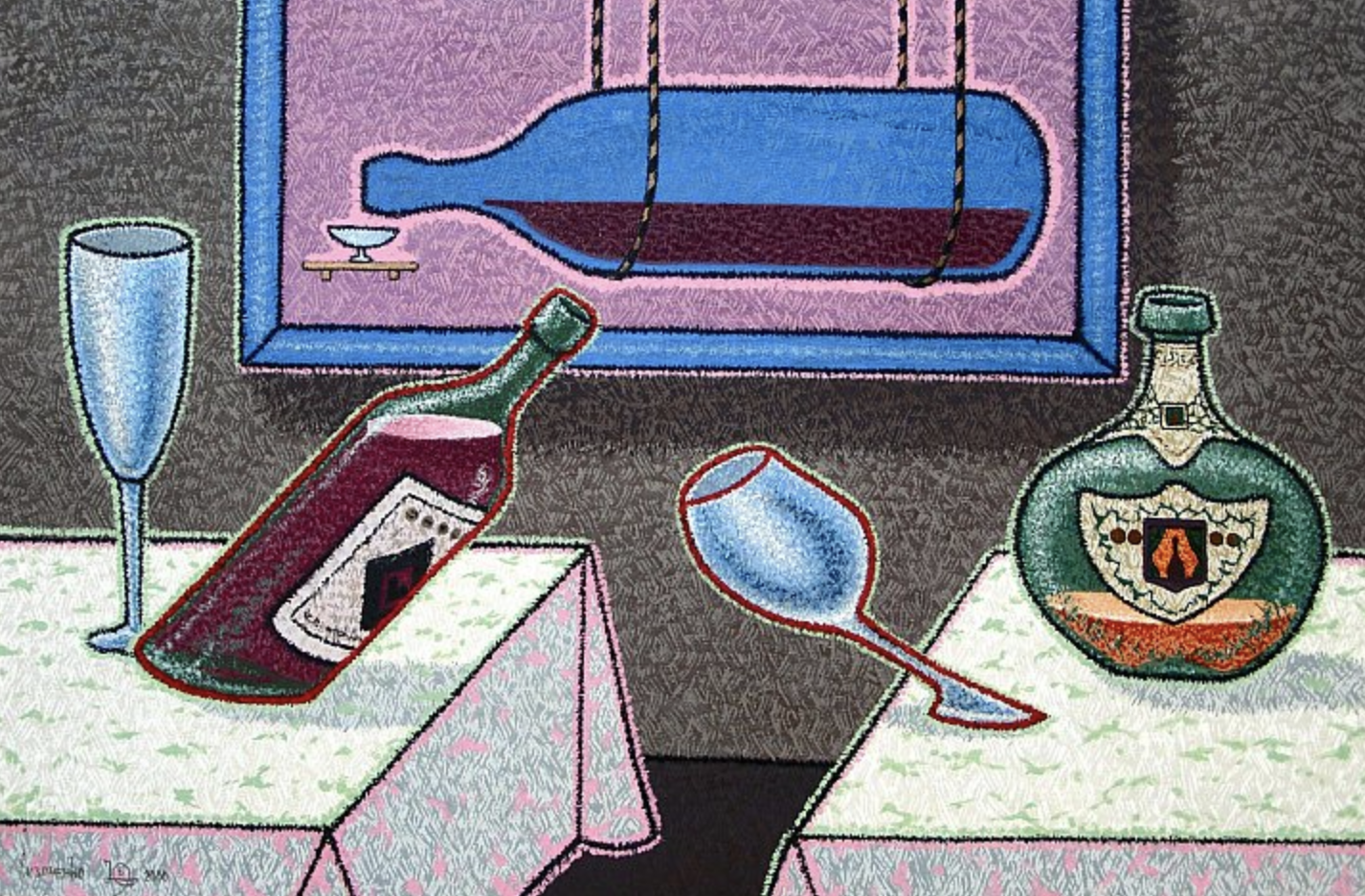

图片怎么处理

哪些应用场景:新人培训、知识库、测试用例生成

评论

匿名评论隐私政策