AI Agent 四象限法则:自动化到智能化的跃迁

AI Agent 四象限法则:自动化到智能化的跃迁

蔡坨坨转载请注明出处❤️

作者:测试蔡坨坨

原文链接:caituotuo.top/db85e15d.html

前言

你好,我是测试蔡坨坨。

2025年被称为 Agent 元年。

然而眼看这一年都快结束了,我们不禁要问——

什么才是真正的 Agent?

又有多少 Agent 真正落地,而不是停留在 PPT 和概念里?

Agent 本质

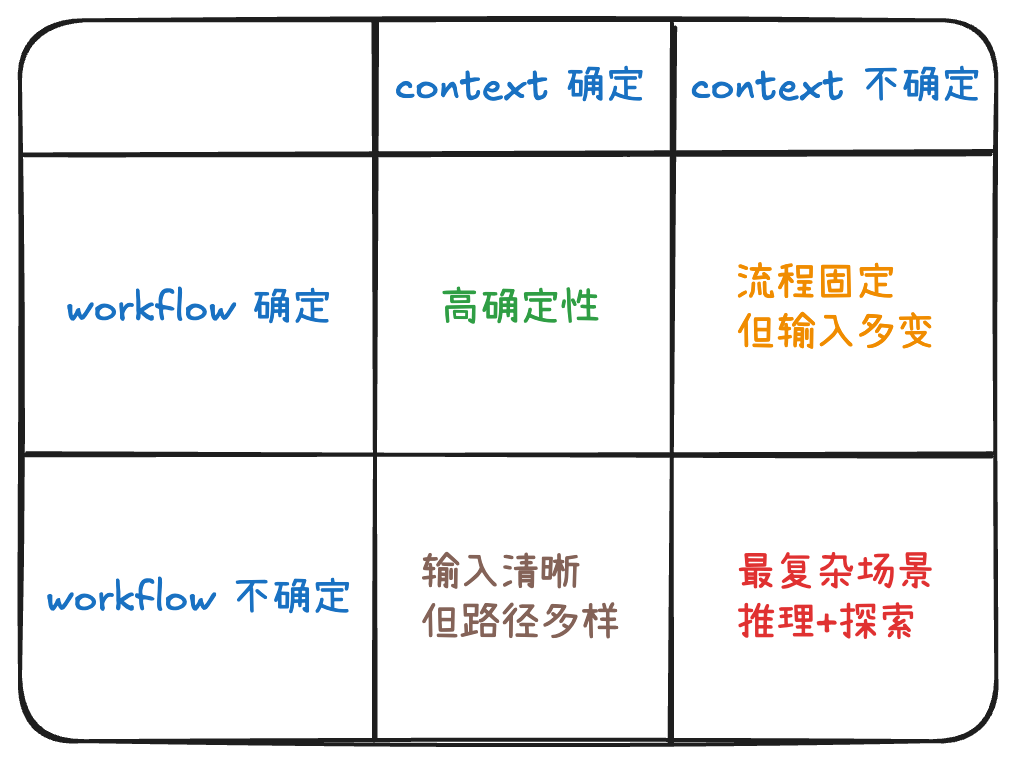

Agent 的本质,其实由两个核心变量决定:

一个是 控制任务走向的 Workflow(工作流),另一个是 控制内容生成的 Context(上下文)。

基于这两个维度,我们可以从 “流程是否固定” 和 “输入是否可预知” 两个角度出发,去界定 Agent 的能力边界和智能水平。

Agent 四象限法则

高确定性

当 Workflow 和 Context 的确定性都很高时,这类任务就容易被自动化,类似传统的 RPA(Robotic Process Automation,机器人流程自动化。是指利用软件机器人或智能自动化工具来模拟和自动执行重复性、规律性、高度结构化的业务流程和任务,从而提高工作效率、减少人力成本、降低错误率等。)

在这个象限里,我们回到熟悉的 “流程清晰、输入可控” 的世界。例如:发票处理、表单填报…… 流程标准、材料格式统一、变数少。只要规范做得好、流程设计得严谨,它跑起来就稳定。

但,也因为 “确定性太强” 而错失 “智能化” 的机会,发挥空间相对有限,需要前期就把技术工作人为完善,AI 主要起到简单的工具调用功能。

流程固定但输入多变

当 Workflow 确定,但 Context 不确定,这里流程依然标准化、可控,但输入或上下文的不确定变大。就需要 Agent 在语义和理解上补全,例如:智能客服、合同解析,需要通过外部检索、知识图谱等工具来弥补信息的缺口,让推理结果更符合预期。

在这个阶段,智能化的关键不是流程更多,而是能否让 Agent 识别大量变化语义、保持响应质量。精准引导 Agent 的语义理解和补全确实很难,大模型输出的不确定性仍然是需要解决的问题。

这也是 “Agentic Workflow” 的演进,传统自动化流程面对突变、非结构化场景时力不从心,而 Agentic 强调 “Tool Use、Planning、Reflection” 三步。

输入清晰但路径多样

当 Context 确定,但 Workflow 不确定时,输入清晰但走法多样,这就需要 Agent 具备自主规划能力。例如:市场分析报告生成、个性化推荐系统,用户输入 “我想要2025年中国消费市场趋势”,输入(主题)明确,但 Agent 要自己查资料、整理结构、定位报告走向、生成最终输出。流程不是死板的。

在 “Agentic Workflow” 中,规划(Planning)是核心能力之一, Agent 要能 “分解任务 -> 计划执行 -> 反思” 形成闭环。

大多数端到端强化学习 Agent 都擅长处理这类任务,因为它们在训练阶段就习得大量的路径规划和解题思路。这种场景考验的是 Agent 的规划能力和决策智能。

双重不确定:通用 Agent

当 Workflow 和 Context 都不确定的情况下,这意味着 Agent 既要理解语境、还要规划流程,还要探索路径。 例如:跨部门信息收集、创新方案设计、Multi Agent 等任务都属于这一类别,这也是最接近通用人工智能真实挑战的场景。

这类 Agent 更偏向于通用型智能体,执行效果很大程度上取决于为其配备的工具丰富度。编程能力的最大化开放变得尤为重要,比如让 Agent 学会到 GitHub 找仓库、克隆并修改代码来解决问题,真正做到像人一样工作。

回到开头的问题:什么是 Agent ?

它是一个能够 在目标导向下,基于上下文自主决策并行动的智能体系统。

在这个系统中,Workflow 让它有序地前进,Context 让它懂得何时、为何、如何行动。

Agent = Workflow × Context × 自主性

既具备流程执行能力,又拥有内容理解的智慧,更重要的是,它能根据环境反馈不断优化自身。